martes, 12 de noviembre de 2019

miércoles, 6 de noviembre de 2019

teclado

TECLADO

En informática, un teclado es un dispositivo o periférico de entrada, en parte inspirado en el teclado de las máquinas de escribir, que utiliza un sistema de botones o teclas, para que actúen como palancas mecánicas o interruptores electrónicos que envían toda la información a la computadora o al teléfono móvil.

tipos

Según su forma física

Diseñados para dar una mayor comodidad para el usuario, ayudándole a tener una posición más relajada de los brazos.

Hoy en día existen también los teclados en pantalla, también llamados

teclados virtuales, que son (como su mismo nombre indica) teclados

representados en la pantalla, que se utilizan con el ratón o con un

dispositivo especial (podría ser un joystick). Estos teclados se utilizan mayoritariamente en los dispositivos móviles como teléfonos, tabletas y PDA.

En el mercado hay una gran variedad de teclados.

En informática, un teclado es un dispositivo o periférico de entrada, en parte inspirado en el teclado de las máquinas de escribir, que utiliza un sistema de botones o teclas, para que actúen como palancas mecánicas o interruptores electrónicos que envían toda la información a la computadora o al teléfono móvil.

tipos

Según su forma física

Teclado ergonómico

Teclado multimedia

Añade teclas especiales que llaman a algunos programas en el computador, a modo de acceso directo, como pueden ser el programa de correo electrónico, la calculadora, el reproductor multimedia, etc.Teclado flexible

Estos teclados son de plástico suave o silicona que se puede doblar sobre sí mismo. Durante su uso, estos teclados pueden adaptarse a superficies irregulares, y son más resistentes a los líquidos que los teclados estándar. Estos también pueden ser conectados a dispositivos portátiles y teléfonos inteligentes. Algunos modelos pueden ser completamente sumergidos en agua, por lo que hospitales y laboratorios los usan, ya que pueden ser desinfectados.1Teclado en pantalla

Teclado en pantalla disponible en un teléfono Android.

Teclados de proyección

Existen teclados de proyección, de igual tamaño que un teclado estándar pero que utilizan láser. Se pueden conectar por USB, Bluetooth o Wi-Fi.Teclados de cúpula de goma

Teclados de membrana

Los teclados de membrana están construidos con dos láminas (membranas) plásticas y delgadas, con pistas conductoras grabadas en la cara interior, y una tercera membrana de separación, agujereada en las zonas en las que va una tecla. Cuando se hace presión sobre ellas, se tocan, pasando la electricidad de una a otra, con lo cual se puede saber que tecla está pulsada. Los teclados de membrana sufren bastante con el uso; por ello, los ordenadores actuales ya no los incorporan. Fueron muy usados en el pasado, aunque la membrana ha sido utilizada para la aislación de lluvias también es utilizada para la aislación térmica que atrae. Su tecnología se basa en membranas delgadas que conducen la señal al presionar una tecla. Este teclado sirve en parte para que los restos que se cuelan entre las rendijas sean más fáciles de sacar y así el teclado no se contamine.Teclados capacitivos

Son los que emplean sensores capacitivos para interacción del usuario.Teclados de contacto metálico

Teclados mecánicos

Según el puerto de conexión

Puede ser:- Teclado con conector Paralelo: Obsoleto.

- Teclado con conector DIN o PS/2: El conector DIN fue usado por pocas computadoras, y fue remplazada rápidamente, más que nada por su tamaño. El PS/2, que también se le denomina «Mini DIN», es parecido al conector DIN, pero con un tamaño más reducido, y se sigue utilizando hoy en día pero cada vez en menor medida (siendo remplazado por el USB en gran parte). Se caracterizan por ser redondos y contener varios pines en su interior. En la actualidad, están siendo sustituidos por los teclados con conectores USB.

- Teclado con conector USB: Aunque los teclados USB comienzan a verse al poco de definirse el estándar USB, es con la aparición de la Apple iMac, que trae tanto teclado como mouse USB de serie cuando se estandariza el soporte de este tipo de teclado. Además tiene la ventaja de hacerlo independiente del hardware al que se conecta.

- Teclado inalámbrico: Suelen ser teclados comunes donde la comunicación entre el computador y el periférico se realiza a través de rayos infrarrojos, ondas de radio o mediante Bluetooth.

ratón o mouse

MOUSE

El ratón o mouse (en inglés pronunciado /maʊs/) es un dispositivo apuntador utilizado para facilitar el manejo de un entorno gráfico en una computadora. Generalmente está fabricado en plástico, y se utiliza con una de las manos. Detecta su movimiento relativo en dos dimensiones por la superficie plana en la que se apoya, reflejándose habitualmente a través de un puntero, cursor o flecha en el monitor. El ratón se puede conectar de forma alámbrica (puertos PS/2 y USB) o inalámbricamente (comunicación inalámbrica o wireless,

por medio de un adaptador USB se conecta a la computadora y esta manda

la señal al ratón, también pueden ser por medio de conectividad bluetooth o infrarrojo).

El ratón o mouse (en inglés pronunciado /maʊs/) es un dispositivo apuntador utilizado para facilitar el manejo de un entorno gráfico en una computadora. Generalmente está fabricado en plástico, y se utiliza con una de las manos. Detecta su movimiento relativo en dos dimensiones por la superficie plana en la que se apoya, reflejándose habitualmente a través de un puntero, cursor o flecha en el monitor. El ratón se puede conectar de forma alámbrica (puertos PS/2 y USB) o inalámbricamente (comunicación inalámbrica o wireless,

por medio de un adaptador USB se conecta a la computadora y esta manda

la señal al ratón, también pueden ser por medio de conectividad bluetooth o infrarrojo).

Es un periférico de entrada imprescindible en una computadora de escritorio para la mayoría de las personas, y pese a la aparición de otras tecnologías con una función similar, como la pantalla táctil, la práctica demuestra todavía su vida útil. No obstante, en el futuro podría ser posible mover el cursor o el puntero con los ojos o basarse en el reconocimiento de voz.

tipos o modelos

Tienen una gran esfera de plástico o goma,

de varias capas, en su parte inferior para mover dos ruedas que generan

pulsos en respuesta al movimiento de éste sobre la superficie. Una

variante es el modelo de Honeywell que utiliza dos ruedas inclinadas noventa grados entre ellas en vez de una esfera.

La circuitería interna cuenta los pulsos generados por la rueda y envía la información a la computadora, que mediante software procesa e interpreta.

Es el formato más popular y más económico, sin embargo existen

multitud de características añadidas que pueden elevar su precio, por

ejemplo si hacen uso de tecnología láser

como sensor de movimiento. En le correr de la primera década del siglo

XXI se distribuyen con dos tipos de conectores posibles, tipo USB y PS/2; antiguamente también era popular usar el puerto serie.

Es el preferido por los videojugadores experimentados, ya que la velocidad de transmisión de datos por cable entre el ratón y la computadora es óptima en juegos que requieren de una gran precisión.

La tecnología infrarroja (IR) utiliza una señal de onda infrarroja

como medio de transmisión de datos, popular también entre los controles o

mandos remotos de televisiones, equipos de música

o en telefonía celular. A diferencia de la anterior, tiene un alcance

medio inferior a los 3 metros, y tanto el emisor como el receptor deben

estar en una misma línea visual de contacto directo ininterrumpido para

que la señal se reciba correctamente. Por ello su éxito ha sido menor,

llegando incluso a desaparecer del mercado.

La tecnología Bluetooth (BT) es la más reciente como transmisión inalámbrica (estándar IEEE 802.15.1),

que cuenta con cierto éxito en otros dispositivos. Su alcance es de

unos 10 metros o 30 pies (que corresponde a la Clase 2 del estándar

Bluetooth).

tomado de: https://es.wikipedia.org/wiki/Ratón

El ratón o mouse (en inglés pronunciado /maʊs/) es un dispositivo apuntador utilizado para facilitar el manejo de un entorno gráfico en una computadora. Generalmente está fabricado en plástico, y se utiliza con una de las manos. Detecta su movimiento relativo en dos dimensiones por la superficie plana en la que se apoya, reflejándose habitualmente a través de un puntero, cursor o flecha en el monitor. El ratón se puede conectar de forma alámbrica (puertos PS/2 y USB) o inalámbricamente (comunicación inalámbrica o wireless,

por medio de un adaptador USB se conecta a la computadora y esta manda

la señal al ratón, también pueden ser por medio de conectividad bluetooth o infrarrojo).

El ratón o mouse (en inglés pronunciado /maʊs/) es un dispositivo apuntador utilizado para facilitar el manejo de un entorno gráfico en una computadora. Generalmente está fabricado en plástico, y se utiliza con una de las manos. Detecta su movimiento relativo en dos dimensiones por la superficie plana en la que se apoya, reflejándose habitualmente a través de un puntero, cursor o flecha en el monitor. El ratón se puede conectar de forma alámbrica (puertos PS/2 y USB) o inalámbricamente (comunicación inalámbrica o wireless,

por medio de un adaptador USB se conecta a la computadora y esta manda

la señal al ratón, también pueden ser por medio de conectividad bluetooth o infrarrojo).

Es un periférico de entrada imprescindible en una computadora de escritorio para la mayoría de las personas, y pese a la aparición de otras tecnologías con una función similar, como la pantalla táctil, la práctica demuestra todavía su vida útil. No obstante, en el futuro podría ser posible mover el cursor o el puntero con los ojos o basarse en el reconocimiento de voz.

tipos o modelos

Por mecanismo

Mecánico

¿Cómo se captura el movimiento de un ratón mecánico estándar?

- Al arrastrarlo sobre la superficie gira la bola.

- Esta, a su vez, mueve los rodillos ortogonales.

- Estos están unidos a unos discos de codificación óptica, opacos pero perforados.

- Dependiendo de su posición pueden dejar pasar o interrumpir señales infrarrojas de un diodo led.

- Estos pulsos ópticos son captados por sensores que obtienen así unas señales digitales de la velocidad vertical y horizontal actual para trasmitirse finalmente a la computadora.

La circuitería interna cuenta los pulsos generados por la rueda y envía la información a la computadora, que mediante software procesa e interpreta.

Óptico

Es una variante que carece de la bola de goma que evita el frecuente problema de la acumulación de suciedad en el eje de transmisión, y por sus características ópticas es menos propenso a sufrir un inconveniente similar. Se considera uno de los más modernos y prácticos actualmente. Puede ofrecer un límite de 800 ppp, como cantidad de puntos distintos que puede reconocer en 2,54 centímetros (una pulgada); a menor cifra peor actuará el sensor de movimientos. Su funcionamiento se basa en un sensor óptico que fotografía la superficie sobre la que se encuentra y detectando las variaciones entre sucesivas fotografías, se determina si el ratón ha cambiado su posición. En superficies pulidas o sobre determinados materiales brillantes, el ratón óptico causa movimiento nervioso sobre la pantalla, por eso se hace necesario el uso de una alfombrilla de ratón o superficie que, para este tipo, no debe ser brillante y mejor si carece de grabados multicolores que puedan «confundir» la información luminosa devuelta.Láser

Este tipo es más sensible y preciso, haciéndolo aconsejable especialmente para los diseñadores gráficos y los jugadores de videojuegos. También detecta el movimiento deslizándose sobre una superficie horizontal, pero el haz de luz de tecnología óptica se sustituye por un láser con resoluciones a partir de 2000 ppp, lo que se traduce en un aumento significativo de la precisión y sensibilidad.Trackball

Artículo principal: Trackball

En concepto de trackball

es una idea que parte del hecho: se debe mover el puntero, no el

dispositivo, por lo que se adapta para presentar una bola, de tal forma

que cuando se coloque la mano encima se pueda mover mediante el dedo pulgar,

sin necesidad de desplazar nada más ni toda la mano como antes. De esta

manera se reduce el esfuerzo y la necesidad de espacio, además de

evitarse un posible dolor de antebrazo

por el movimiento de éste. A algunas personas, sin embargo, no les

termina de resultar realmente cómodo. Este tipo ha sido muy útil por

ejemplo en la informatización de la navegación marítima.

Multitáctil

El principal ejemplo de los ratones táctiles es el Magic Mouse de Apple, y están diseñados con una carcasa superior de una pieza. Su superficie es lisa, sin botones, ya que se trata de una zona multitáctil en el que todo el ratón hace de botón y lo puedan usar tanto los diestros como los zurdos.Por conexión

Cableado

Es el preferido por los videojugadores experimentados, ya que la velocidad de transmisión de datos por cable entre el ratón y la computadora es óptima en juegos que requieren de una gran precisión.

Inalámbrico

En este caso el dispositivo carece de un cable que lo comunique con la computadora, en su lugar utiliza algún tipo de tecnología inalámbrica. Para ello requiere un receptor que reciba la señal inalámbrica que produce, mediante baterías, el ratón. El receptor normalmente se conecta a la computadora a través de un puerto USB o PS/2. Según la tecnología inalámbrica usada pueden distinguirse varias posibilidades:Radiofrecuencia

La Radio Frecuencia (RF) es el tipo más común y económico de este tipo de tecnologías. Funciona enviando una señal a una frecuencia de 2.4 GHz, popular en la telefonía móvil o celular, la misma que los estándares IEEE 802.11b y IEEE 802.11g. Es popular, entre otras cosas, por sus pocos errores de desconexión o interferencias con otros equipos inalámbricos, además de disponer de un alcance suficiente: hasta unos 10 metros.Infrarrojo

Bluetooth

tomado de: https://es.wikipedia.org/wiki/Ratón

monitor

MONITORES

El monitor de computadora (en Hispanoamérica) o torre (en España) es el principal dispositivo de salida (interfaz), que muestra datos o información al usuario.

El monitor de computadora (en Hispanoamérica) o torre (en España) es el principal dispositivo de salida (interfaz), que muestra datos o información al usuario.

También puede considerarse un periférico de Entrada/Salida si el monitor tiene pantalla táctil o multitáctil.

tipos

Un monitor puede clasificarse, según la tecnología empleada para formar las imágenes en:

El monitor de computadora (en Hispanoamérica) o torre (en España) es el principal dispositivo de salida (interfaz), que muestra datos o información al usuario.

El monitor de computadora (en Hispanoamérica) o torre (en España) es el principal dispositivo de salida (interfaz), que muestra datos o información al usuario.

También puede considerarse un periférico de Entrada/Salida si el monitor tiene pantalla táctil o multitáctil.

tipos

Un monitor puede clasificarse, según la tecnología empleada para formar las imágenes en:

- Tubo de rayos catódicos o CRT (Cathode Ray Tube)

- Pantalla de cristal líquido o LCD (Liquid Crystal Display)

- Pantalla de plasma o PDP (Plasma Display Panel)

- TFT LCD (Thin Film Transistor: transistor de películas finas)

- Pantalla LED (Light Emitting Diode: diodo emisor de luz)

- OLED (Organic Light-Emitting Diode: diodo orgánico de emisión de luz)

- AMOLED (Active Matrix OLED: OLED de matriz activa)

- Super AMOLED (Super Active Matrix Organic Light-Emitting Diode: Súper AMOLED)

- En tanto, según el estándar, un monitor puede clasificarse en: Monitor numérico, MDA, CGA, EGA, analógico, VGA, SVGA, entre otros.

- En cuanto a los colores que usan los monitores pueden ser:

- Monitor monocromático

- Monitor policromático.

- En cuanto a si es solamente un Periférico de salida (S) o Periférico de Entrada/Salida (E/S):

- Monitor no táctil: S

- Pantalla táctil (touch screen): E/S

- Multitáctil (multitouch): E/S

- Existen algunos conceptos cuantificables relacionados con los monitores y sirven para medir su calidad, estos son: píxel, paso (dot pitch), resolución, tasa de refresco, dimensión del tubo, tamaño de punto, área útil.

- Monitor de “pantalla curva” o CRT

- Monitor de pantalla plana: LCD, TFT, LED, PDP

conectores internos y externos

CONECTORES

conectores internos

son aquellas ranuras de expansión que se conectan a la placa base, además de los puertos internos o interfaces. Existen varios tipos de slots:

ºIDE: El interfaz ATA (Advanced Technology Attachment) , originalmente conocido como IDE (Integrated device Electronics), es un estándar de interfaz para la conexión de los dispositivos de almacenamiento masivo de datos y las unidades ópticas que utiliza el estándar derivado de ATA y el estándar ATAPI.

ºPCI: consiste en un bus de ordenador estándar para conectar dispositivos periféricos directamente a su placa base. Estos dispositivos pueden ser circuitos integrados ajustados en ésta (los llamados "dispositivos planares" en la especificación PCI) o tarjetas de expansión que se ajustan en conectores.

ºAGP: es un puerto, puesto que sólo se puede conectar un dispositivo, mientras que en el bus se pueden conectar varios.

ºSATA: Es un interfaz de transmisión entre la placa base y algunos dispositivos, como el disco duro. Al tener velocidad de transmisón de datos más alta y mayor ancho de banda sustituitán al resto de las interfaces.

Puertos para conectar periféricos de entrada/salida a la placa base:

ºPraralelo: Transmite los datos en paralelo, como indica su nombre, y se usa para impresora y escáneres, pero está siendo desplazado por el USB.

ºUSB: Permite la interconexión de prácticamente cualquier dispositivo. Además, la conexión y el reconocimiento se realizan sin necesidad de reiniciar el dispositivo.

ºIEEE 1394: Es un interfaz que permite la interconexión de cámaras, vídeos, teléfonos, discos duros externos, impresoras y escáneres al ordenador.

ºPuerto infrarrojos IrDA: La trnsmisión de datos se realiza sin soporte físico por rayos infrarrojos. Las velocidades pueden ser de los 4 Mbps. Se usa en teléfonos móviles, portátiles, PDA y calculadoras científicas.

conectores externos

Los conectores externos, son los conectores que presenta la placa para conectarse los dispositivos externos. o bien integrados en la placa, o, a través de tarjetas de expansión.

conectores internos

son aquellas ranuras de expansión que se conectan a la placa base, además de los puertos internos o interfaces. Existen varios tipos de slots:

ºIDE: El interfaz ATA (Advanced Technology Attachment) , originalmente conocido como IDE (Integrated device Electronics), es un estándar de interfaz para la conexión de los dispositivos de almacenamiento masivo de datos y las unidades ópticas que utiliza el estándar derivado de ATA y el estándar ATAPI.

ºPCI: consiste en un bus de ordenador estándar para conectar dispositivos periféricos directamente a su placa base. Estos dispositivos pueden ser circuitos integrados ajustados en ésta (los llamados "dispositivos planares" en la especificación PCI) o tarjetas de expansión que se ajustan en conectores.

ºAGP: es un puerto, puesto que sólo se puede conectar un dispositivo, mientras que en el bus se pueden conectar varios.

ºSATA: Es un interfaz de transmisión entre la placa base y algunos dispositivos, como el disco duro. Al tener velocidad de transmisón de datos más alta y mayor ancho de banda sustituitán al resto de las interfaces.

Puertos para conectar periféricos de entrada/salida a la placa base:

ºPraralelo: Transmite los datos en paralelo, como indica su nombre, y se usa para impresora y escáneres, pero está siendo desplazado por el USB.

ºUSB: Permite la interconexión de prácticamente cualquier dispositivo. Además, la conexión y el reconocimiento se realizan sin necesidad de reiniciar el dispositivo.

ºIEEE 1394: Es un interfaz que permite la interconexión de cámaras, vídeos, teléfonos, discos duros externos, impresoras y escáneres al ordenador.

ºPuerto infrarrojos IrDA: La trnsmisión de datos se realiza sin soporte físico por rayos infrarrojos. Las velocidades pueden ser de los 4 Mbps. Se usa en teléfonos móviles, portátiles, PDA y calculadoras científicas.

conectores externos

Los conectores externos, son los conectores que presenta la placa para conectarse los dispositivos externos. o bien integrados en la placa, o, a través de tarjetas de expansión.

unidad de disco optico

UNIDAD DE DISCO ÓPTICO

En informática, la unidad de disco óptico es la unidad de disco que utiliza una luz láser como parte del proceso de lectura o escritura de datos desde un archivo a discos ópticos a través de haces de luz que interpretan las refracciones provocadas sobre su propia emisión.

En informática, la unidad de disco óptico es la unidad de disco que utiliza una luz láser como parte del proceso de lectura o escritura de datos desde un archivo a discos ópticos a través de haces de luz que interpretan las refracciones provocadas sobre su propia emisión.

Los discos compactos (CD), discos versátiles digitales (DVD) y discos Blu-ray (BD) son los tipos de medios ópticos más comunes que pueden ser leídos y grabados por estas unidades.

El “almacenamiento óptico”1 es una variante de almacenamiento informático surgida a finales del siglo XX. La historia del almacenamiento de datos en medios ópticos se remonta a los años comprendidos en las décadas de 1970 y 1980. Se trata de aquellos dispositivos que son capaces de guardar datos por medio de un rayo láser en su superficie plástica, ya que se almacenan por medio de ranuras microscópicas (ó ranuras quemadas). La información queda grabada en la superficie de manera física, por lo que solo el calor (puede producir deformaciones en la superficie del disco) y las ralladuras pueden producir la pérdida de los datos, en cambio es inmune a los campos magnéticos y la humedad.

Las unidades de discos ópticos son una parte integrante de los aparatos de consumo autónomos como los reproductores de CD, reproductores de DVD y grabadoras de DVD. También son usados muy comúnmente en las computadoras para leer software y medios de consumo distribuidos en formato de disco, y para grabar discos para el intercambio y archivo de datos. Las unidades de discos ópticos (junto a las memorias flash) han desplazado a las disqueteras y a las unidades de cintas magnéticas para este propósito debido al bajo coste de los medios ópticos y la casi ubicuidad de las unidades de discos ópticos en las computadoras y en hardware de entretenimiento de consumo.

La grabación de discos en general es restringida a la distribución y copiado de seguridad a pequeña escala, siendo más lenta y más cara en términos materiales por unidad que el proceso de moldeo usado para fabricar discos planchados en masa.

tipos y caracteristicas

El disco compacto (conocido como CD, por las siglas en inglés de Compact Disc)

es un soporte digital óptico utilizado para almacenar cualquier tipo de

información (audio, imágenes, vídeo, documentos y otros datos). En

español se puede escribir 'cedé' (como se pronuncia) porque ha sido

aceptada y lexicalizada su pronunciación por el uso; en gran parte de

Latinoamérica se pronuncia 'sidí', como en inglés, pero la Asociación de

Academias de la Lengua Española desaconseja esa pronunciación en el Diccionario panhispánico de dudas. También se acepta 'cederróm' (de CD-ROM).

El DVD es un disco óptico de almacenamiento de datos cuyo estándar surgió en 1995. Sus siglas corresponden con Disco Versátil Digital (Digital Versatile Disc

en inglés), de modo que ambos acrónimos coinciden (en español e

inglés). En sus inicios, la V intermedia hacía referencia a video (digital videodisk), debido a su desarrollo como reemplazo del formato VHS para la distribución de video a los hogares.

HD DVD (por las siglas de High Density Digital Versatile Disc),

traducido al español como disco digital versátil de alta densidad, fue

un formato de almacenamiento óptico desarrollado como un estándar para

el DVD de alta definición por las empresas Toshiba, Microsoft y NEC, así

como por varias productoras de cine. Puede almacenar hasta 30 GB.

El disco Blu-ray, conocido como Blu-ray o simplemente BD (en inglés:

Blu-ray Disc), es un formato de disco óptico de nueva generación,

desarrollado por la Blu-ray Disc Association (BDA), empleado para vídeo

de alta definición (HD), 3D y UltraHD y con mayor capacidad de

almacenamiento de datos de alta densidad que la del DVD.

El Universal Media Disc (UMD), disco universal de

medios, es un disco óptico desarrollado por Sony conocido sobre todo por

su uso en la PlayStation Portable (PSP). Puede contener 900 MB de

datos, 1,8 GB en doble capa. Puede incluir juegos, películas, música, o

combinaciones de estos elementos.

En informática, la unidad de disco óptico es la unidad de disco que utiliza una luz láser como parte del proceso de lectura o escritura de datos desde un archivo a discos ópticos a través de haces de luz que interpretan las refracciones provocadas sobre su propia emisión.

En informática, la unidad de disco óptico es la unidad de disco que utiliza una luz láser como parte del proceso de lectura o escritura de datos desde un archivo a discos ópticos a través de haces de luz que interpretan las refracciones provocadas sobre su propia emisión.

Los discos compactos (CD), discos versátiles digitales (DVD) y discos Blu-ray (BD) son los tipos de medios ópticos más comunes que pueden ser leídos y grabados por estas unidades.

El “almacenamiento óptico”1 es una variante de almacenamiento informático surgida a finales del siglo XX. La historia del almacenamiento de datos en medios ópticos se remonta a los años comprendidos en las décadas de 1970 y 1980. Se trata de aquellos dispositivos que son capaces de guardar datos por medio de un rayo láser en su superficie plástica, ya que se almacenan por medio de ranuras microscópicas (ó ranuras quemadas). La información queda grabada en la superficie de manera física, por lo que solo el calor (puede producir deformaciones en la superficie del disco) y las ralladuras pueden producir la pérdida de los datos, en cambio es inmune a los campos magnéticos y la humedad.

Las unidades de discos ópticos son una parte integrante de los aparatos de consumo autónomos como los reproductores de CD, reproductores de DVD y grabadoras de DVD. También son usados muy comúnmente en las computadoras para leer software y medios de consumo distribuidos en formato de disco, y para grabar discos para el intercambio y archivo de datos. Las unidades de discos ópticos (junto a las memorias flash) han desplazado a las disqueteras y a las unidades de cintas magnéticas para este propósito debido al bajo coste de los medios ópticos y la casi ubicuidad de las unidades de discos ópticos en las computadoras y en hardware de entretenimiento de consumo.

La grabación de discos en general es restringida a la distribución y copiado de seguridad a pequeña escala, siendo más lenta y más cara en términos materiales por unidad que el proceso de moldeo usado para fabricar discos planchados en masa.

tipos y caracteristicas

CD

DVD

HD DVD

Blu-ray

UMD

ranuras de expansión

RANURAS DE EXPANSIÓN

Las ranuras están conectadas entre sí. Una computadora personal dispone generalmente de ocho unidades, aunque puede llegar a tener hasta doce. En las placas base del tipo LPX, las ranuras de expansión no se encuentran sobre la placa, sino en un conector especial denominado riser card (tarjeta vertical).

tomado de: https://es.wikipedia.org/wiki/Ranura_de_expansión

Las ranuras están conectadas entre sí. Una computadora personal dispone generalmente de ocho unidades, aunque puede llegar a tener hasta doce. En las placas base del tipo LPX, las ranuras de expansión no se encuentran sobre la placa, sino en un conector especial denominado riser card (tarjeta vertical).

tomado de: https://es.wikipedia.org/wiki/Ranura_de_expansión

RAM (memoria de acceso aleatorio)

MEMORIA RAM

La memoria de acceso aleatorio (Random Access Memory, RAM) se utiliza como memoria de trabajo de computadoras y otros dispositivos para el sistema operativo, los programas y la mayor parte del software.

En la RAM se cargan todas las instrucciones que ejecuta la unidad central de procesamiento (procesador) y otras unidades del computador, además de contener los datos que manipulan los distintos programas.

La memoria de acceso aleatorio (Random Access Memory, RAM) se utiliza como memoria de trabajo de computadoras y otros dispositivos para el sistema operativo, los programas y la mayor parte del software.

En la RAM se cargan todas las instrucciones que ejecuta la unidad central de procesamiento (procesador) y otras unidades del computador, además de contener los datos que manipulan los distintos programas.

Se denominan «de acceso aleatorio» porque se puede leer o escribir en una posición de memoria con un tiempo de espera igual para cualquier posición, no siendo necesario seguir un orden para acceder (acceso secuencial) a la información de la manera más rápida posible.

Durante el encendido de la computadora, la rutina POST verifica que los módulos de RAM estén conectados de manera correcta. En el caso que no existan o no se detecten los módulos, la mayoría de tarjetas madres emiten una serie de sonidos que indican la ausencia de memoria principal. Terminado ese proceso, la memoria BIOS puede realizar un test básico sobre la memoria RAM indicando fallos mayores en la misma.

tipos

Las dos formas principales de RAM moderna son:

La memoria de acceso aleatorio (Random Access Memory, RAM) se utiliza como memoria de trabajo de computadoras y otros dispositivos para el sistema operativo, los programas y la mayor parte del software.

En la RAM se cargan todas las instrucciones que ejecuta la unidad central de procesamiento (procesador) y otras unidades del computador, además de contener los datos que manipulan los distintos programas.

La memoria de acceso aleatorio (Random Access Memory, RAM) se utiliza como memoria de trabajo de computadoras y otros dispositivos para el sistema operativo, los programas y la mayor parte del software.

En la RAM se cargan todas las instrucciones que ejecuta la unidad central de procesamiento (procesador) y otras unidades del computador, además de contener los datos que manipulan los distintos programas.

Se denominan «de acceso aleatorio» porque se puede leer o escribir en una posición de memoria con un tiempo de espera igual para cualquier posición, no siendo necesario seguir un orden para acceder (acceso secuencial) a la información de la manera más rápida posible.

Durante el encendido de la computadora, la rutina POST verifica que los módulos de RAM estén conectados de manera correcta. En el caso que no existan o no se detecten los módulos, la mayoría de tarjetas madres emiten una serie de sonidos que indican la ausencia de memoria principal. Terminado ese proceso, la memoria BIOS puede realizar un test básico sobre la memoria RAM indicando fallos mayores en la misma.

tipos

Las dos formas principales de RAM moderna son:

- SRAM (Static Random Access Memory), RAM estática, memoria estática de acceso aleatorio.

- volátiles.

- no volátiles:

- NVRAM (non-volatile random access memory), memoria de acceso aleatorio no volátil

- MRAM (magnetoresistive random-access memory), memoria de acceso aleatorio magnetorresistiva o magnética

- DRAM (Dynamic Random Access Memory), RAM dinámica, memoria dinámica de acceso aleatorio.

- DRAM Asincrónica (Asynchronous Dynamic Random Access Memory), memoria de acceso aleatorio dinámica asincrónica.

- FPM RAM (Fast Page Mode RAM)

- EDO RAM (Extended Data Output RAM)

- SDRAM (Synchronous Dynamic Random-Access Memory, memoria de acceso aleatorio dinámica sincrónica)

- Rambus:

- SDR SDRAM (Single Data Rate Synchronous Dynamic Random-Access Memory, SDRAM de tasa de datos simple)

- DDR SDRAM (Double Data Rate Synchronous Dynamic Random-Access Memory, SDRAM de tasa de datos doble)

- DDR2 SDRAM (Double Data Rate type two SDRAM, SDRAM de tasa de datos doble de tipo dos)

- DDR3 SDRAM (Double Data Rate type three SDRAM, SDRAM de tasa de datos doble de tipo tres)

- DDR4 SDRAM (Double Data Rate type four SDRAM, SDRAM de tasa de datos doble de tipo cuatro).

- DDR5 SDRAM (Double Data Rate type five SDRAM, SDRAM de tasa de datos doble de tipo cinco).

- DDR6 SDRAM (Double Data Rate type six SDRAM, SDRAM de tasa de datos doble de tipo seis).

tomado de: https://es.wikipedia.org/wiki/Memoria_de_acceso_aleatorio

- DRAM Asincrónica (Asynchronous Dynamic Random Access Memory), memoria de acceso aleatorio dinámica asincrónica.

unidad de disco duro

LA UNIDAD DE DISCO DURO

En informática, la unidad de disco duro o unidad de disco rígido (en inglés: hard disk drive, HDD) es un dispositivo de almacenamiento de datos que emplea un sistema de grabación magnética para almacenar y recuperar archivos digitales. Se compone de uno o más platos o discos rígidos, recubiertos con material magnético y unidos por un mismo eje

que gira a gran velocidad dentro de una caja metálica sellada. Sobre

cada plato, y en cada una de sus caras, se sitúa un cabezal de

lectura/escritura que flota sobre una delgada lámina de aire generada

por la rotación de los discos.1 Permite el acceso aleatorio a los datos, lo que significa que los bloques de datos se pueden almacenar o recuperar en cualquier orden y no solo de forma secuencial. Las unidades de disco duro son un tipo de memoria no volátil, que retienen los datos almacenados incluso cuando están apagados.

En informática, la unidad de disco duro o unidad de disco rígido (en inglés: hard disk drive, HDD) es un dispositivo de almacenamiento de datos que emplea un sistema de grabación magnética para almacenar y recuperar archivos digitales. Se compone de uno o más platos o discos rígidos, recubiertos con material magnético y unidos por un mismo eje

que gira a gran velocidad dentro de una caja metálica sellada. Sobre

cada plato, y en cada una de sus caras, se sitúa un cabezal de

lectura/escritura que flota sobre una delgada lámina de aire generada

por la rotación de los discos.1 Permite el acceso aleatorio a los datos, lo que significa que los bloques de datos se pueden almacenar o recuperar en cualquier orden y no solo de forma secuencial. Las unidades de disco duro son un tipo de memoria no volátil, que retienen los datos almacenados incluso cuando están apagados.

El primer disco duro fue inventado por IBM, en 19565. A lo largo de los años, han disminuido los precios de los discos duros, al mismo tiempo que han multiplicado su capacidad, siendo la principal opción de almacenamiento secundario para computadoras personales, desde su aparición en los años 1960.6 Los discos duros han mantenido su posición dominante gracias a los constantes incrementos en la densidad de grabación, que se ha mantenido a la par de las necesidades de almacenamiento secundario.6

Mejorados continuamente, los discos duros han mantenido esta posición en la era moderna de los servidores y las computadoras personales. Más de 224 compañías han fabricado unidades de disco duro históricamente, aunque después de una extensa consolidación de la industria, la mayoría de las unidades son fabricadas por Seagate, Toshiba y Western Digital. Los discos duros dominan el volumen de almacenamiento producido (exabytes por año) para servidores. Aunque la producción está creciendo lentamente, los ingresos por ventas y los envíos de unidades están disminuyendo debido a que las unidades de estado sólido (SSD) tienen mayores tasas de transferencia de datos, mayor densidad de almacenamiento de área, mejor confiabilidad 7, y tiempos de acceso y latencia mucho más bajos.891011

Los ingresos por SSD, la mayoría de los cuales utilizan NAND, exceden ligeramente los de los HDD.12 Aunque los SSD tienen un costo por bit casi 10 veces mayor, están reemplazando a los discos duros en aplicaciones donde la velocidad, el consumo de energía, el tamaño pequeño y la durabilidad son importantes.1011

Los tamaños también han variado mucho, desde los primeros discos IBM hasta los formatos estandarizados actualmente: 3,5 pulgadas los modelos para PC y servidores, y 2,5 pulgadas los modelos para dispositivos portátiles. Todos se comunican con la computadora a través del controlador de disco, empleando una interfaz estandarizada. Los más comunes hasta los años 2000 han sido IDE (también llamado ATA o PATA), SCSI/SAS (generalmente usado en servidores y estaciones de trabajo). Desde el 2000 en adelante ha ido masificándose el uso de los SATA. Existe además los discos de canal de fibra (FC), empleados exclusivamente en servidores. Las unidades externas se conectan principalmente por USB.

Los tamaños también han variado mucho, desde los primeros discos IBM hasta los formatos estandarizados actualmente: 3,5 pulgadas los modelos para PC y servidores, y 2,5 pulgadas los modelos para dispositivos portátiles. Todos se comunican con la computadora a través del controlador de disco, empleando una interfaz estandarizada. Los más comunes hasta los años 2000 han sido IDE (también llamado ATA o PATA), SCSI/SAS (generalmente usado en servidores y estaciones de trabajo). Desde el 2000 en adelante ha ido masificándose el uso de los SATA. Existe además los discos de canal de fibra (FC), empleados exclusivamente en servidores. Las unidades externas se conectan principalmente por USB.

Para poder utilizar un disco duro, un sistema operativo debe aplicar un formato de bajo nivel que defina una o más particiones. La operación de formateo requiere el uso de una fracción del espacio disponible en el disco, que dependerá del sistema de archivos o formato empleado. Además, los fabricantes de discos duros, unidades de estado sólido y tarjetas flash miden la capacidad de los mismos usando prefijos del Sistema Internacional, que emplean múltiplos de potencias de 1000 según la normativa IEC e IEEE, en lugar de los prefijos binarios, que emplean múltiplos de potencias de 1024, y son los usados por sistemas operativos de Microsoft. Esto provoca que en algunos sistemas operativos sea representado como múltiplos 1024 o como 1000, y por tanto existan confusiones, por ejemplo un disco duro de 500 GB, en algunos sistemas operativos será representado como 465 GiB (es decir gibibytes; 1 GiB = 1024 MiB) y en otros como 500 GB.

El rendimiento de un disco duro se especifica por el tiempo requerido para mover las cabezas a una pista o cilindro (tiempo de acceso promedio) agregando el tiempo que toma para que el sector deseado se mueva debajo de la cabeza (latencia media , que es una función de la velocidad de rotación física en las revoluciones por minuto) y, finalmente, la velocidad a la que se transmiten los datos (velocidad de datos).

tomado de:https://es.wikipedia.org/wiki/Unidad_de_disco_duro

En informática, la unidad de disco duro o unidad de disco rígido (en inglés: hard disk drive, HDD) es un dispositivo de almacenamiento de datos que emplea un sistema de grabación magnética para almacenar y recuperar archivos digitales. Se compone de uno o más platos o discos rígidos, recubiertos con material magnético y unidos por un mismo eje

que gira a gran velocidad dentro de una caja metálica sellada. Sobre

cada plato, y en cada una de sus caras, se sitúa un cabezal de

lectura/escritura que flota sobre una delgada lámina de aire generada

por la rotación de los discos.1 Permite el acceso aleatorio a los datos, lo que significa que los bloques de datos se pueden almacenar o recuperar en cualquier orden y no solo de forma secuencial. Las unidades de disco duro son un tipo de memoria no volátil, que retienen los datos almacenados incluso cuando están apagados.

En informática, la unidad de disco duro o unidad de disco rígido (en inglés: hard disk drive, HDD) es un dispositivo de almacenamiento de datos que emplea un sistema de grabación magnética para almacenar y recuperar archivos digitales. Se compone de uno o más platos o discos rígidos, recubiertos con material magnético y unidos por un mismo eje

que gira a gran velocidad dentro de una caja metálica sellada. Sobre

cada plato, y en cada una de sus caras, se sitúa un cabezal de

lectura/escritura que flota sobre una delgada lámina de aire generada

por la rotación de los discos.1 Permite el acceso aleatorio a los datos, lo que significa que los bloques de datos se pueden almacenar o recuperar en cualquier orden y no solo de forma secuencial. Las unidades de disco duro son un tipo de memoria no volátil, que retienen los datos almacenados incluso cuando están apagados.El primer disco duro fue inventado por IBM, en 19565. A lo largo de los años, han disminuido los precios de los discos duros, al mismo tiempo que han multiplicado su capacidad, siendo la principal opción de almacenamiento secundario para computadoras personales, desde su aparición en los años 1960.6 Los discos duros han mantenido su posición dominante gracias a los constantes incrementos en la densidad de grabación, que se ha mantenido a la par de las necesidades de almacenamiento secundario.6

Mejorados continuamente, los discos duros han mantenido esta posición en la era moderna de los servidores y las computadoras personales. Más de 224 compañías han fabricado unidades de disco duro históricamente, aunque después de una extensa consolidación de la industria, la mayoría de las unidades son fabricadas por Seagate, Toshiba y Western Digital. Los discos duros dominan el volumen de almacenamiento producido (exabytes por año) para servidores. Aunque la producción está creciendo lentamente, los ingresos por ventas y los envíos de unidades están disminuyendo debido a que las unidades de estado sólido (SSD) tienen mayores tasas de transferencia de datos, mayor densidad de almacenamiento de área, mejor confiabilidad 7, y tiempos de acceso y latencia mucho más bajos.891011

Los ingresos por SSD, la mayoría de los cuales utilizan NAND, exceden ligeramente los de los HDD.12 Aunque los SSD tienen un costo por bit casi 10 veces mayor, están reemplazando a los discos duros en aplicaciones donde la velocidad, el consumo de energía, el tamaño pequeño y la durabilidad son importantes.1011

Los tamaños también han variado mucho, desde los primeros discos IBM hasta los formatos estandarizados actualmente: 3,5 pulgadas los modelos para PC y servidores, y 2,5 pulgadas los modelos para dispositivos portátiles. Todos se comunican con la computadora a través del controlador de disco, empleando una interfaz estandarizada. Los más comunes hasta los años 2000 han sido IDE (también llamado ATA o PATA), SCSI/SAS (generalmente usado en servidores y estaciones de trabajo). Desde el 2000 en adelante ha ido masificándose el uso de los SATA. Existe además los discos de canal de fibra (FC), empleados exclusivamente en servidores. Las unidades externas se conectan principalmente por USB.

Los tamaños también han variado mucho, desde los primeros discos IBM hasta los formatos estandarizados actualmente: 3,5 pulgadas los modelos para PC y servidores, y 2,5 pulgadas los modelos para dispositivos portátiles. Todos se comunican con la computadora a través del controlador de disco, empleando una interfaz estandarizada. Los más comunes hasta los años 2000 han sido IDE (también llamado ATA o PATA), SCSI/SAS (generalmente usado en servidores y estaciones de trabajo). Desde el 2000 en adelante ha ido masificándose el uso de los SATA. Existe además los discos de canal de fibra (FC), empleados exclusivamente en servidores. Las unidades externas se conectan principalmente por USB.

Para poder utilizar un disco duro, un sistema operativo debe aplicar un formato de bajo nivel que defina una o más particiones. La operación de formateo requiere el uso de una fracción del espacio disponible en el disco, que dependerá del sistema de archivos o formato empleado. Además, los fabricantes de discos duros, unidades de estado sólido y tarjetas flash miden la capacidad de los mismos usando prefijos del Sistema Internacional, que emplean múltiplos de potencias de 1000 según la normativa IEC e IEEE, en lugar de los prefijos binarios, que emplean múltiplos de potencias de 1024, y son los usados por sistemas operativos de Microsoft. Esto provoca que en algunos sistemas operativos sea representado como múltiplos 1024 o como 1000, y por tanto existan confusiones, por ejemplo un disco duro de 500 GB, en algunos sistemas operativos será representado como 465 GiB (es decir gibibytes; 1 GiB = 1024 MiB) y en otros como 500 GB.

El rendimiento de un disco duro se especifica por el tiempo requerido para mover las cabezas a una pista o cilindro (tiempo de acceso promedio) agregando el tiempo que toma para que el sector deseado se mueva debajo de la cabeza (latencia media , que es una función de la velocidad de rotación física en las revoluciones por minuto) y, finalmente, la velocidad a la que se transmiten los datos (velocidad de datos).

tomado de:https://es.wikipedia.org/wiki/Unidad_de_disco_duro

microprocesador

MICROPROCESADOR

El microprocesador (o simplemente procesador) es el circuito integrado central más complejo de un sistema informático; a modo de ilustración, se le suele llamar por analogía el «cerebro» de un ordenador.

El microprocesador (o simplemente procesador) es el circuito integrado central más complejo de un sistema informático; a modo de ilustración, se le suele llamar por analogía el «cerebro» de un ordenador.

Es el encargado de ejecutar los programas, desde el sistema operativo hasta las aplicaciones de usuario; solo ejecuta instrucciones programadas en lenguaje de bajo nivel, realizando operaciones aritméticas y lógicas simples, tales como sumar, restar, multiplicar, dividir, las lógicas binarias y accesos a memoria.

Puede contener una o más unidades centrales de procesamiento (CPU) constituidas, esencialmente, por registros, una unidad de control, una unidad aritmético lógica (ALU) y una unidad de cálculo en coma flotante (conocida antiguamente como «coprocesador matemático»).

El microprocesador está conectado generalmente mediante un zócalo específico de la placa base de la computadora; normalmente para su correcto y estable funcionamiento, se le incorpora un sistema de refrigeración que consta de un disipador de calor, fabricado de algún material de alta conductividad térmica, como cobre o aluminio, y de uno o más ventiladores que eliminan el exceso del calor absorbido por el disipador. Entre el disipador y la cápsula del microprocesador usualmente se coloca pasta térmica para mejorar la conductividad del calor. Existen otros métodos más eficaces, como la refrigeración líquida o el uso de células peltier para refrigeración extrema, aunque estas técnicas se utilizan casi exclusivamente para aplicaciones especiales, tales como en las prácticas de overclocking.

La medición del rendimiento de un microprocesador es una tarea compleja, dado que existen diferentes tipos de "cargas" que pueden ser procesadas con diferente efectividad por procesadores de la misma gama. Una métrica del rendimiento es la frecuencia de reloj que permite comparar procesadores con núcleos de la misma familia, siendo este un indicador muy limitado dada la gran variedad de diseños con los cuales se comercializan los procesadores de una misma marca y referencia. Un sistema informático de alto rendimiento puede estar equipado con varios microprocesadores trabajando en paralelo, y un microprocesador puede, a su vez, estar constituido por varios núcleos físicos o lógicos. Un núcleo físico se refiere a una porción interna del microprocesador casi-independiente que realiza todas las actividades de una CPU solitaria, un núcleo lógico es la simulación de un núcleo físico a fin de repartir de manera más eficiente el procesamiento. Existe una tendencia de integrar el mayor número de elementos dentro del propio procesador, aumentando así la eficiencia energética y la miniaturización. Entre los elementos integrados están las unidades de punto flotante, controladores de la memoria RAM, controladores de buses y procesadores dedicados de vídeo.

tomado de:https://es.wikipedia.org/wiki/Microprocesador

El microprocesador (o simplemente procesador) es el circuito integrado central más complejo de un sistema informático; a modo de ilustración, se le suele llamar por analogía el «cerebro» de un ordenador.

El microprocesador (o simplemente procesador) es el circuito integrado central más complejo de un sistema informático; a modo de ilustración, se le suele llamar por analogía el «cerebro» de un ordenador.

Es el encargado de ejecutar los programas, desde el sistema operativo hasta las aplicaciones de usuario; solo ejecuta instrucciones programadas en lenguaje de bajo nivel, realizando operaciones aritméticas y lógicas simples, tales como sumar, restar, multiplicar, dividir, las lógicas binarias y accesos a memoria.

Puede contener una o más unidades centrales de procesamiento (CPU) constituidas, esencialmente, por registros, una unidad de control, una unidad aritmético lógica (ALU) y una unidad de cálculo en coma flotante (conocida antiguamente como «coprocesador matemático»).

El microprocesador está conectado generalmente mediante un zócalo específico de la placa base de la computadora; normalmente para su correcto y estable funcionamiento, se le incorpora un sistema de refrigeración que consta de un disipador de calor, fabricado de algún material de alta conductividad térmica, como cobre o aluminio, y de uno o más ventiladores que eliminan el exceso del calor absorbido por el disipador. Entre el disipador y la cápsula del microprocesador usualmente se coloca pasta térmica para mejorar la conductividad del calor. Existen otros métodos más eficaces, como la refrigeración líquida o el uso de células peltier para refrigeración extrema, aunque estas técnicas se utilizan casi exclusivamente para aplicaciones especiales, tales como en las prácticas de overclocking.

La medición del rendimiento de un microprocesador es una tarea compleja, dado que existen diferentes tipos de "cargas" que pueden ser procesadas con diferente efectividad por procesadores de la misma gama. Una métrica del rendimiento es la frecuencia de reloj que permite comparar procesadores con núcleos de la misma familia, siendo este un indicador muy limitado dada la gran variedad de diseños con los cuales se comercializan los procesadores de una misma marca y referencia. Un sistema informático de alto rendimiento puede estar equipado con varios microprocesadores trabajando en paralelo, y un microprocesador puede, a su vez, estar constituido por varios núcleos físicos o lógicos. Un núcleo físico se refiere a una porción interna del microprocesador casi-independiente que realiza todas las actividades de una CPU solitaria, un núcleo lógico es la simulación de un núcleo físico a fin de repartir de manera más eficiente el procesamiento. Existe una tendencia de integrar el mayor número de elementos dentro del propio procesador, aumentando así la eficiencia energética y la miniaturización. Entre los elementos integrados están las unidades de punto flotante, controladores de la memoria RAM, controladores de buses y procesadores dedicados de vídeo.

tomado de:https://es.wikipedia.org/wiki/Microprocesador

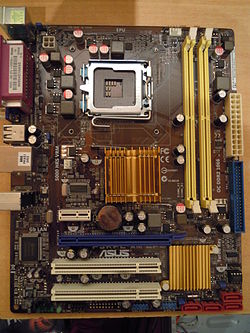

placa base

PLACA BASE

La placa base, también conocida como tarjeta madre, placa madre o placa principal (motherboard o mainboard en inglés), es una tarjeta de circuito impreso a la que se conectan los componentes que constituyen la computadora.

Es una parte fundamental para montar cualquier computadora personal de escritorio o portátil o algún dispositivo. Tiene instalados una serie de circuitos integrados, entre los que se encuentra el circuito integrado auxiliar (chipset), que sirve como centro de conexión entre el microprocesador (CPU), la memoria de acceso aleatorio (RAM), las ranuras de expansión y otros dispositivos.

Va instalada dentro de una carcasa o gabinete que por lo general está hecha de chapa y tiene un panel para conectar dispositivos externos y muchos conectores internos y zócalos para instalar componentes internos.

La placa base, además incluye un firmware llamado BIOS, que le permite realizar las funcionalidades básicas, como pruebas de los dispositivos, vídeo y manejo del teclado, reconocimiento de dispositivos y carga del sistema operativo.

Una placa base típica admite los siguientes componentes:

Por uno o varios de estos conectores de alimentación, una

alimentación eléctrica proporciona a la placa base los diferentes

voltajes e intensidades necesarios para su funcionamiento.

El zócalo (socket) de CPU es un receptáculo que encastra el microprocesador y lo conecta con el resto de componentes a través del bus frontal de la placa base.

Si la placa base dispone de un único zócalo para microprocesador, se denomina monoprocesador. En cambio, si dispone de dos o más zócalos, se denomina placa multiprocesador.

Las placas bases constan de ranuras (slots) de memoria de acceso aleatorio, su número es de 2 a 6 ranuras en una misma placa base común.

En ellas se insertan dichas memorias del tipo conveniente dependiendo de la velocidad, capacidad y fabricante requeridos según la compatibilidad de cada placa base y la CPU.

El chipset es una serie o conjunto de circuitos electrónicos, que gestionan las transferencias de datos entre los diferentes componentes de la computadora (procesador, memoria, tarjeta gráfica, unidad de almacenamiento secundario, etcétera).

El chipset, generalmente se divide en dos secciones:

tomado de: https://es.wikipedia.org/wiki/Placa_base

La placa base, también conocida como tarjeta madre, placa madre o placa principal (motherboard o mainboard en inglés), es una tarjeta de circuito impreso a la que se conectan los componentes que constituyen la computadora.

Es una parte fundamental para montar cualquier computadora personal de escritorio o portátil o algún dispositivo. Tiene instalados una serie de circuitos integrados, entre los que se encuentra el circuito integrado auxiliar (chipset), que sirve como centro de conexión entre el microprocesador (CPU), la memoria de acceso aleatorio (RAM), las ranuras de expansión y otros dispositivos.

Va instalada dentro de una carcasa o gabinete que por lo general está hecha de chapa y tiene un panel para conectar dispositivos externos y muchos conectores internos y zócalos para instalar componentes internos.

La placa base, además incluye un firmware llamado BIOS, que le permite realizar las funcionalidades básicas, como pruebas de los dispositivos, vídeo y manejo del teclado, reconocimiento de dispositivos y carga del sistema operativo.

Componentes de la placa base

Diagrama de una placa base típica.

- Conectores de alimentación de energía eléctrica.

- Zócalo de CPU (monoprocesador) o zócalos de CPU (multiprocesador).

- Ranuras de RAM.

- Chipset.

Conectores de alimentación

Conectores de la fuente de alimentación de tipo ATX2 para PC:

(1) mini molex para FDD.

(2) Molex universal: para dispositivos IDE, HDD y unidad de disco óptico.

(3) para dispositivos SATA.

(4) para tarjetas gráficas de 8 pines, separable para 6 pines.

(5) para tarjeta gráfica de 6 pines.

(6) para placa base de 8 pines.

(7) para CPU P4, combinado para el conector de la placa base de 8 pines a 12V.

(8) ATX2 de 24 pines.

(1) mini molex para FDD.

(2) Molex universal: para dispositivos IDE, HDD y unidad de disco óptico.

(3) para dispositivos SATA.

(4) para tarjetas gráficas de 8 pines, separable para 6 pines.

(5) para tarjeta gráfica de 6 pines.

(6) para placa base de 8 pines.

(7) para CPU P4, combinado para el conector de la placa base de 8 pines a 12V.

(8) ATX2 de 24 pines.

Puertos de CPU

Placa

base para computadora personal de escritorio mostrando sus componentes

típicos e interfaces. Este modelo fue fabricado por Foxconn en 2007

usando la disposición microATX, una de las más utilizadas para computadoras personales.

Si la placa base dispone de un único zócalo para microprocesador, se denomina monoprocesador. En cambio, si dispone de dos o más zócalos, se denomina placa multiprocesador.

Ranuras de RAM

En ellas se insertan dichas memorias del tipo conveniente dependiendo de la velocidad, capacidad y fabricante requeridos según la compatibilidad de cada placa base y la CPU.

Chipset

El chipset, generalmente se divide en dos secciones:

- Puente norte (northbridge): gestiona la interconexión entre el microprocesador, la memoria RAM y la unidad de procesamiento gráfico.

- Puente sur (southbridge): gestiona la interconexión entre los periféricos y los dispositivos de almacenamiento, como los discos duros o las unidades de disco óptico.

tomado de: https://es.wikipedia.org/wiki/Placa_base

sistema informatico

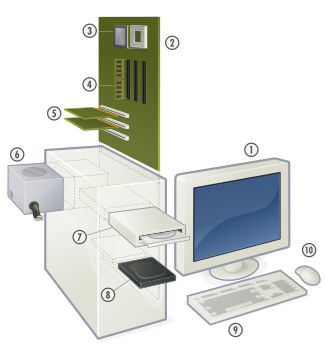

EL SISTEMA INFORMATICO

Un sistema informático (SI) es un sistema que permite almacenar y procesar informacion; es el conjunto de partes interrelacionadas: hardware, software y personal informático. El hardware incluye computadoras o cualquier tipo de dispositivo electrónico, que consisten en procesadores, memoria, sistemas de almacenamiento externo, etc. El software incluye al sistema operativo, firmware y aplicaciones,

siendo especialmente importante los sistemas de gestión de bases de

datos. Por último, el soporte humano incluye al personal técnico que

apoyan y mantienen el sistema (analistas, programadores, operarios,

etc.) y a los usuarios que lo utilizan.

Un sistema informático (SI) es un sistema que permite almacenar y procesar informacion; es el conjunto de partes interrelacionadas: hardware, software y personal informático. El hardware incluye computadoras o cualquier tipo de dispositivo electrónico, que consisten en procesadores, memoria, sistemas de almacenamiento externo, etc. El software incluye al sistema operativo, firmware y aplicaciones,

siendo especialmente importante los sistemas de gestión de bases de

datos. Por último, el soporte humano incluye al personal técnico que

apoyan y mantienen el sistema (analistas, programadores, operarios,

etc.) y a los usuarios que lo utilizan.

hardware

La palabra hardware en informática se refiere a las partes físicas, tangibles, de un sistema informático; sus componentes eléctricos, electrónicos, electromecánicos y mecánicos.1 Los cables, así como los gabinetes o cajas, los periféricos de todo tipo, y cualquier otro elemento físico involucrado, componen el hardware o soporte físico; contrariamente, el soporte lógico e intangible es el llamado software.

El término es propio del idioma inglés, y su traducción al español no tiene un significado acorde, por tal motivo se lo ha adoptado tal cual es y suena. La Real Academia Española lo define como «Conjunto de los componentes que integran la parte material de una computadora».2

El término, aunque sea lo más común, no solamente se aplica a las

computadoras, también es a menudo utilizado en otras áreas de la vida

diaria y la tecnología. Por ejemplo, hardware también se refiere a herramientas y máquinas, y en electrónica hardware se refiere a todos los componentes electrónicos, eléctricos, electromecánicos, mecánicos, cableados y tarjetas de circuitos impresos.

El término es propio del idioma inglés, y su traducción al español no tiene un significado acorde, por tal motivo se lo ha adoptado tal cual es y suena. La Real Academia Española lo define como «Conjunto de los componentes que integran la parte material de una computadora».2

El término, aunque sea lo más común, no solamente se aplica a las

computadoras, también es a menudo utilizado en otras áreas de la vida

diaria y la tecnología. Por ejemplo, hardware también se refiere a herramientas y máquinas, y en electrónica hardware se refiere a todos los componentes electrónicos, eléctricos, electromecánicos, mecánicos, cableados y tarjetas de circuitos impresos.

Otros ejemplos donde se aplica el término hardware son, en relación a los robots,34 así como en relación a los teléfonos móviles, las cámaras fotográficas, los reproductores digitales, o cualquier otro dispositivo electrónico. Cuando dichos dispositivos también procesan datos, poseen firmware y/o software además de hardware.

La historia del hardware de computador se puede clasificar en cuatro generaciones, cada una caracterizada por un cambio tecnológico de importancia. Una primera delimitación podría hacerse entre hardware principal (véase figura), como el estrictamente necesario para el funcionamiento normal del equipo, y el «complementario», como el que realiza funciones específicas.

El hardware principal de un computador se compone de una unidad central de procesamiento(CPU); encargada de procesar los datos; una memoria rápida de trabajo para almacenamiento temporal; una unidad de almacenamiento fija para mantener software y datos así como extraerlos de ella; uno o varios periféricos de entrada, los que permiten el ingreso de la información y uno o varios periféricos de salida, que posibilitan dar salida (normalmente en forma visual, impresa o auditiva) a los datos procesados.

SOFTWARE

Se conoce como software1 al soporte lógico de un sistema informático, que comprende el conjunto de los componentes lógicos necesarios que hacen posible la realización de tareas específicas, en contraposición a los componentes físicos que son llamados hardware. La interacción entre el software y el hardware hace operativo un ordenador (u otro dispositivo), es decir, el Software envía instrucciones que el Hardware ejecuta, haciendo posible su funcionamiento.

Los componentes lógicos incluyen, entre muchos otros, las aplicaciones informáticas, tales como el procesador de texto, que permite al usuario realizar todas las tareas concernientes a la edición de textos; el llamado software de sistema, tal como el sistema operativo, que básicamente permite al resto de los programas funcionar adecuadamente, facilitando también la interacción entre los componentes físicos y el resto de las aplicaciones, y proporcionando una interfaz con el usuario.2

El software en su gran mayoría, está escrito en lenguajes de programación de alto nivel, ya que son más fáciles y eficientes para que los programadores los usen, porque son más cercanos al Lenguaje natural respecto del lenguaje de máquina.3 Los lenguajes de alto nivel se traducen a lenguaje de máquina utilizando un compilador o un intérprete, o bien una combinación de ambos. El software también puede estar escrito en lenguaje ensamblador , que es de bajo nivel y tiene una alta correspondencia con las instrucciones de lenguaje máquina; se traduce al lenguaje de la máquina utilizando un ensamblador.

El anglicismo software es el más ampliamente difundido al referirse a este concepto, especialmente en la jerga técnica; en tanto que el término sinónimo «logicial», derivado del término francés logiciel, es utilizado mayormente en países y zonas de influencia francesa.

PERIFERICOS

En informática, periférico es la denominación genérica para designar al aparato o dispositivo auxiliar e independiente conectado a la unidad central de procesamiento de una computadora.

Se consideran periféricos a las unidades o dispositivos de hardware a través de los cuales la computadora se comunica con el exterior, y también a los sistemas que almacenan o archivan la información, sirviendo de memoria auxiliar de la memoria principal.1

Se considera periférico al conjunto de dispositivos que sin pertenecer al núcleo fundamental de la computadora, formado por la unidad central de procesamiento (CPU) y la memoria central, permitan realizar operaciones de entrada/salida (E/S) complementarias al proceso de datos que realiza la CPU. Estas tres unidades básicas en un computador, CPU, memoria central y el subsistema de E/S, están comunicadas entre sí por tres buses o canales de comunicación:

Un sistema informático (SI) es un sistema que permite almacenar y procesar informacion; es el conjunto de partes interrelacionadas: hardware, software y personal informático. El hardware incluye computadoras o cualquier tipo de dispositivo electrónico, que consisten en procesadores, memoria, sistemas de almacenamiento externo, etc. El software incluye al sistema operativo, firmware y aplicaciones,

siendo especialmente importante los sistemas de gestión de bases de

datos. Por último, el soporte humano incluye al personal técnico que

apoyan y mantienen el sistema (analistas, programadores, operarios,

etc.) y a los usuarios que lo utilizan.

Un sistema informático (SI) es un sistema que permite almacenar y procesar informacion; es el conjunto de partes interrelacionadas: hardware, software y personal informático. El hardware incluye computadoras o cualquier tipo de dispositivo electrónico, que consisten en procesadores, memoria, sistemas de almacenamiento externo, etc. El software incluye al sistema operativo, firmware y aplicaciones,

siendo especialmente importante los sistemas de gestión de bases de

datos. Por último, el soporte humano incluye al personal técnico que

apoyan y mantienen el sistema (analistas, programadores, operarios,

etc.) y a los usuarios que lo utilizan.hardware

La palabra hardware en informática se refiere a las partes físicas, tangibles, de un sistema informático; sus componentes eléctricos, electrónicos, electromecánicos y mecánicos.1 Los cables, así como los gabinetes o cajas, los periféricos de todo tipo, y cualquier otro elemento físico involucrado, componen el hardware o soporte físico; contrariamente, el soporte lógico e intangible es el llamado software.

El término es propio del idioma inglés, y su traducción al español no tiene un significado acorde, por tal motivo se lo ha adoptado tal cual es y suena. La Real Academia Española lo define como «Conjunto de los componentes que integran la parte material de una computadora».2

El término, aunque sea lo más común, no solamente se aplica a las

computadoras, también es a menudo utilizado en otras áreas de la vida

diaria y la tecnología. Por ejemplo, hardware también se refiere a herramientas y máquinas, y en electrónica hardware se refiere a todos los componentes electrónicos, eléctricos, electromecánicos, mecánicos, cableados y tarjetas de circuitos impresos.

El término es propio del idioma inglés, y su traducción al español no tiene un significado acorde, por tal motivo se lo ha adoptado tal cual es y suena. La Real Academia Española lo define como «Conjunto de los componentes que integran la parte material de una computadora».2

El término, aunque sea lo más común, no solamente se aplica a las

computadoras, también es a menudo utilizado en otras áreas de la vida

diaria y la tecnología. Por ejemplo, hardware también se refiere a herramientas y máquinas, y en electrónica hardware se refiere a todos los componentes electrónicos, eléctricos, electromecánicos, mecánicos, cableados y tarjetas de circuitos impresos.

Otros ejemplos donde se aplica el término hardware son, en relación a los robots,34 así como en relación a los teléfonos móviles, las cámaras fotográficas, los reproductores digitales, o cualquier otro dispositivo electrónico. Cuando dichos dispositivos también procesan datos, poseen firmware y/o software además de hardware.

La historia del hardware de computador se puede clasificar en cuatro generaciones, cada una caracterizada por un cambio tecnológico de importancia. Una primera delimitación podría hacerse entre hardware principal (véase figura), como el estrictamente necesario para el funcionamiento normal del equipo, y el «complementario», como el que realiza funciones específicas.

El hardware principal de un computador se compone de una unidad central de procesamiento(CPU); encargada de procesar los datos; una memoria rápida de trabajo para almacenamiento temporal; una unidad de almacenamiento fija para mantener software y datos así como extraerlos de ella; uno o varios periféricos de entrada, los que permiten el ingreso de la información y uno o varios periféricos de salida, que posibilitan dar salida (normalmente en forma visual, impresa o auditiva) a los datos procesados.

SOFTWARE

Se conoce como software1 al soporte lógico de un sistema informático, que comprende el conjunto de los componentes lógicos necesarios que hacen posible la realización de tareas específicas, en contraposición a los componentes físicos que son llamados hardware. La interacción entre el software y el hardware hace operativo un ordenador (u otro dispositivo), es decir, el Software envía instrucciones que el Hardware ejecuta, haciendo posible su funcionamiento.

Los componentes lógicos incluyen, entre muchos otros, las aplicaciones informáticas, tales como el procesador de texto, que permite al usuario realizar todas las tareas concernientes a la edición de textos; el llamado software de sistema, tal como el sistema operativo, que básicamente permite al resto de los programas funcionar adecuadamente, facilitando también la interacción entre los componentes físicos y el resto de las aplicaciones, y proporcionando una interfaz con el usuario.2

El software en su gran mayoría, está escrito en lenguajes de programación de alto nivel, ya que son más fáciles y eficientes para que los programadores los usen, porque son más cercanos al Lenguaje natural respecto del lenguaje de máquina.3 Los lenguajes de alto nivel se traducen a lenguaje de máquina utilizando un compilador o un intérprete, o bien una combinación de ambos. El software también puede estar escrito en lenguaje ensamblador , que es de bajo nivel y tiene una alta correspondencia con las instrucciones de lenguaje máquina; se traduce al lenguaje de la máquina utilizando un ensamblador.

El anglicismo software es el más ampliamente difundido al referirse a este concepto, especialmente en la jerga técnica; en tanto que el término sinónimo «logicial», derivado del término francés logiciel, es utilizado mayormente en países y zonas de influencia francesa.

PERIFERICOS

En informática, periférico es la denominación genérica para designar al aparato o dispositivo auxiliar e independiente conectado a la unidad central de procesamiento de una computadora.

Se consideran periféricos a las unidades o dispositivos de hardware a través de los cuales la computadora se comunica con el exterior, y también a los sistemas que almacenan o archivan la información, sirviendo de memoria auxiliar de la memoria principal.1

Se considera periférico al conjunto de dispositivos que sin pertenecer al núcleo fundamental de la computadora, formado por la unidad central de procesamiento (CPU) y la memoria central, permitan realizar operaciones de entrada/salida (E/S) complementarias al proceso de datos que realiza la CPU. Estas tres unidades básicas en un computador, CPU, memoria central y el subsistema de E/S, están comunicadas entre sí por tres buses o canales de comunicación:

- Direcciones, para seleccionar la dirección del dato o del periférico al que se quiere acceder.

- Control, básicamente para seleccionar la operación a realizar sobre el dato (principalmente lectura, escritura o modificación).

- Datos, por donde circulan los datos.

historia y generaciones de los pc

HISTORIA DE LOS COMPUTADORES

En 1670 el filósofo y matemático alemán Gottfried Wilhelm Leibniz perfeccionó la máquina de calcular de Pascal e inventó una que también podía multiplicar.

El inventor francés Joseph Marie Jacquard, al diseñar un telar automático, utilizó delgadas placas de madera perforadas para controlar el tejido utilizado en los diseños complejos. Durante la década de 1880 el estadístico estadounidense Herman Hollerith concibió la idea de utilizar tarjetas perforadas, similares a las placas de Jacquard, para procesar datos. Hollerith consiguió compilar la información estadística destinada al censo de población de 1890 de Estados Unidos mediante la utilización de un sistema que hacía pasar tarjetas perforadas sobre contactos eléctricos.

También en el siglo XIX el matemático e inventor británico Charles Babbage elaboró los principios de la computadora digital moderna. Inventó una serie de máquinas, como la máquina diferencial, diseñadas para solucionar problemas matemáticos complejos. Muchos historiadores consideran a Babbage y a su socia, la matemática británica Augusta Ada Byron (1815-1852), hija del poeta inglés Lord Byron, como a los verdaderos inventores de la computadora digital moderna. La tecnología de aquella época no era capaz de trasladar a la práctica sus acertados conceptos; pero una de sus invenciones, la máquina analítica, ya tenía muchas de las características de un ordenador moderno. Incluía una corriente, o flujo de entrada en forma de paquete de tarjetas perforadas, una memoria para guardar los datos, un procesador para las operaciones matemáticas y una impresora para hacer permanente el registro.

Los ordenadores analógicos comenzaron a construirse a principios del siglo XX. Los primeros modelos realizaban los cálculos mediante ejes y engranajes giratorios. Con estas máquinas se evaluaban las aproximaciones numéricas de ecuaciones demasiado difíciles como para poder ser resueltas mediante otros métodos. Durante las dos guerras mundiales se utilizaron sistemas informáticos analógicos, primero mecánicos y más tarde eléctricos, para predecir la trayectoria de los torpedos en los submarinos y para el manejo a distancia de las bombas en la aviación.

Durante la II Guerra Mundial (1939-1945), un equipo de científicos y matemáticos que trabajaban en Bletchley Park, al norte de Londres, crearon lo que se consideró el primer ordenador digital totalmente electrónico: el Colossus. Hacia diciembre de 1943 el Colossus, que incorporaba 1.500 válvulas o tubos de vacío, era ya operativo. Fue utilizado por el equipo dirigido por Alan Turing para descodificar los mensajes de radio cifrados de los alemanes. En 1939 y con independencia de este proyecto, John Atanasoff y Clifford Berry ya habían construido un prototipo de máquina electrónica en el Iowa State College (EEUU). Este prototipo y las investigaciones posteriores se realizaron en el anonimato, y más tarde quedaron eclipsadas por el desarrollo del Calculador e integrador numérico electrónico (en inglés ENIAC, Electronic Numerical Integrator and Computer) en 1946. El ENIAC, que según se demostró se basaba en gran medida en el ordenador Atanasoff-Berry (en inglés ABC, Atanasoff-Berry Computer), obtuvo una patente que caducó en 1973, varias décadas más tarde.

El ENIAC contenía 18.000 válvulas de vacío y tenía una velocidad de varios cientos de multiplicaciones por minuto, pero su programa estaba conectado al procesador y debía ser modificado manualmente. Se construyó un sucesor del ENIAC con un almacenamiento de programa que estaba basado en los conceptos del matemático húngaro-estadounidense John von Neumann. Las instrucciones se almacenaban dentro de una llamada memoria, lo que liberaba al ordenador de las limitaciones de velocidad del lector de cinta de papel durante la ejecución y permitía resolver problemas sin necesidad de volver a conectarse al ordenador.

A finales de la década de 1950 el uso del transistor en los ordenadores marcó el advenimiento de elementos lógicos más pequeños, rápidos y versátiles de lo que permitían las máquinas con válvulas. Como los transistores utilizan mucha menos energía y tienen una vida útil más prolongada, a su desarrollo se debió el nacimiento de máquinas más perfeccionadas, que fueron llamadas ordenadores o computadoras de segunda generación. Los componentes se hicieron más pequeños, así como los espacios entre ellos, por lo que la fabricación del sistema resultaba más barata.

tomado de: https://www.solociencia.com/informatica/computador-historia-historia.htm

Suscribirse a:

Comentarios (Atom)